mercoledì 29 luglio 2015

Ex Machina di Alex Garland: fra cognizione incarnata e robotica evolutiva

Robot, androidi, cyborg, A.I.: chiamateli come vi pare, ma essi vivono e lottano insieme a noi. Sorpassata la classe operaia, è il fantasma della classe robotica che infesta questi folli, insostenibili anni di tecnocapitalismo avanzato. Certo, non si tratta di roba nuova: film come Blade Runner di Ridley Scott o A.I. di Steven Spielberg, piluccando briciole da Asimov e Dick le trasformarono in palle di fuoco visuali da milioni di dollari e spettatori. Questi prodotti culturali erano il sogno (e l'incubo) proibito di teorie cibernetiche sviluppate nel dopoguerra e che raggiunsero il loro heyday negli anni 60 attraverso la costruzione dei primi elaboratori elettronici. Roba finanziata dallo zio Sam, ovviamente. Poi negli anni 70 e 80 si tornò ad indagare la mente umana nel suo rapporto col corpo e l'ambiente, ma l'attenzione venne catturata da futurologici dispositivi di realtà virtuale che promettevano di trascendere il corpo e disperderlo nel ciberspazio. Trainati dal caterpillar Neuromante di William Gibson (1986), fecero incetta di immaginari film come Il tagliaerbe (Leonard, 1992), Jhonny Mnemonic (Longo, 1995), Strange Days (Bigelow, 1995), Nirvana (Salvadores, 1997), eXistenZ (Cronenberg, 1999) fino all'infamoso Matrix (Andy e Lana Wachowsky, 1999) che di Neuromante è una sorta di fratellino filosoficamente imbranato.

Da alcuni anni si sono dati nuovi fuochi alle polveri: all'epopea del "viaggio virtuale" si è sostituita la curiosità verso il "corpo a corpo con i dispositivi", per dirla con Giorgio Agamben, che sta riportando in auge la figura dell'androide. L'intelligenza artificiale non è più un (deus) Ex machina che opera da una posizione disincarnata, bensì un essere dotato di mente e corpo che vive in un ambiente situato. Ambiente che non ha più bisogno di rifarsi agli scenari distopici per sembrare una vera merda, poiché è quello in cui viviamo oggi. Mentre gli androidi di Blade Runner e A.I. si muovevano in un orizzonte decadente ma ipertecnologizzato, il nuovo immaginario cyborg si sviluppa in uno scenario decisamente imborghesito e minimale, senza nessun grande strappo col design proposto dalla marmaglia di Apple e affini. Yin e yang: da un lato cinema e serie tv stanno traslando gli stessi interrogativi che riguardano lo studio della mente e la progettazione di dispositivi intelligenti; dall'altro, la scenarizzazione del nostro divenire post-umano è schiacciata in un presente tutt'altro che utopico o alternativo che possa davvero produrre uno strappo radicale. Ma non tutti i mali vengono per nuocere.

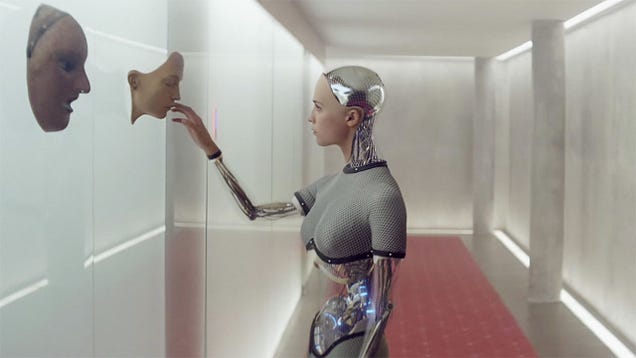

Il film del neoregista Alex Garland è un thriller che uscirà il prossimo 30 luglio in Italia e offre uno spaccato significativo sulle recenti tendenze nel campo della cognizione incarnata e della robotica proattiva ed evoluzionistica. Qui la mente non è più considerata alla stregue di un software che in linea di principio può essere scaricato e traslato su un altro corpo-hardware. Mente, corpo e persino l'ambiente in cui sono situati, partecipano ad un sistema di intelligenza ad incastro. Perdi uno di questi elementi, perdi l'intelligenza. Questo propongono le teorie della cognizione incarnata (embodied cognition): la nostra architettura cognitiva, per quanto estremamente plastica, è il frutto di millenni di evoluzione che sono in larga misura radicati nel Pleistocene, l'era in cui l'essere umano dovette mettere a punto determinate procedure di percezione-azione per sopravvivere all'ambiente che valgono ancora oggi. Ciò che la robotica evoluzionistica e proattiva si propone oggi è proprio quello di programmare le disposizioni di base di un sistema intelligente affinché possa attivamente evolvere interagendo con l'ambiente e il proprio corpo morfologico. Come ricordano Lakoff e Johnson, non penseremmo né ci comporteremmo allo stesso modo se invece di essere degli esseri dotati di braccia e gambe, un fronte e un retro, una parte alta e una bassa, fossimo delle enormi sfere (un esempio su tutti: Giuliano Ferrara). La nostra percezione del movimento e la nostra lettura delle menti altrui è basata su memorie e calcoli predittivi che ci servono per intervenire nella/sulla realtà (afferrare un frutto, scagliare una pietra) e per empatizzare e imparare con/dagli altri (tramite i così detti "neuroni specchio", le stesse aree del cervello atte a compiere un'azione si attivano quando vediamo compierla da un'altro essere). It's a kind of magic!

Per farci digerire questo malloppo teorico, Ex Machina mette in scena un thriller. Abbiamo una versione barbuta e sporty di Zuckerberg (Nathan), CEO della multinazionale informatica "bluebook" [sic!] che seleziona a tradimento un dipendente sfigato (Caleb) per fare il test di Turing ad un prototipo di intelligenza artificiale da lanciare sul mercato. I due sono soli sull'isola, ad eccezione di Kyoko, un'assistente asiatica in supertiro, e la suddetta IA, che possiede le sembianze di una ragazza acqua e sapone. Il suo sistema nervoso non è una cpu (come avrebbe voluto Von Neumann) bensì un sistema distribuito fra i server cloud dell'azienda che confluisce in un wetware, una specie di palloncino d'acqua che svolge le funzioni di un sistema nervoso centrale post-umano. Non c'è dubbio infatti, come vediamo spiattellato sin dal trailer, che l'androide sia effettivamente un essere senziente. Non solo perché è in grado di sostenere una conversazione con Caleb ma piuttosto perché il modo in cui è programmata per interagire con l'ambiente le permette di evolvere il proprio sistema cognitivo e persino la morfologia del suo corpo. Di più. A ben vedere ogni giorno anche noi svolgiamo un test di turing con i nostri simili attraverso quello che viene chiamato mindreading (lettura della mente). Pensateci: noi non abbiamo l'assoluta certezza che quello di fronte a noi sia il nostro amico Paolo, l'amante o il genitore più di quanto, al contrario, siamo abbastanza certi che dietro al al nostro sistema operativo, allo smartphone o al tosta pane si celi una coscienza pari alla nostra. La differenza che ci fa "credere" alla prima categoria rispetto alla seconda è la somiglianza dei metodi di mindreading che gli altri esseri umani applicano a loro volta su di noi, generando quella correlazioni motorio-percettiva che chiamiamo "empatia". Quando questo non avviene nei confronti di altre specie o altri sistemi intelligenti, o decretiamo fallito il test di Turing oppure antropomorfizziamo, con effetti feticistici dalle conseguenze disastrose (maledetto Walt Disney!). E' così che Caleb, in un pieno sbrocco epistemologico, arriverà ad incidersi un braccio per superare il test di Turing su sé stesso: quando la parola non basta, si procede per intensità. E c'è una chicca: nel ruolo di Caleb ritroviamo il corpo di porcellana di Domhnall Gleeson, lo stesso attore che interpreta il clone sintetico di un ragazzo deceduto in Black Mirror, la serie tecno-distopica da cui Ex Machina, oltre a prolungare i personaggi, riprende anche i tempi e le atmosfere.

Ma ciò che di inedito va ad affrontare il film è la questione dei qualia, ovvero gli stati qualitativi dell'esperienza cosciente che, per definizione, dovrebbero essere diversi da soggetto a soggetto. La rossità che tu percepisci nell'osservare un tramonto è diversa da quella che esperisce un'altra persona? Così la quest del film non è più se l'androide sia o non sia senziente, ma se, una volta uscita dal laboratorio-prigione di Nathan, sarà in grado di avere un'esperienza qualitativa del mondo. Si tratta dell'esperimento mentale di Mary nella stanza, che viene infatti citato nel film. Mary è un'ipotetica donna che è nata e cresciuta in una stanza in bianco e nero. Nonostante non abbia mai percepito i colori, Mary conosce tutto quello che c'è da sapere sulla percezione dei colori. Il domandone filosofico da 1 milione di dollari è: se Mary uscisse dalla stanza e percepisse per la prima volta i colori, la sua esperienza si arricchirebbe di un fattore qualitativo ulteriore oppure no? Se sì, i così detti qualia avrebbero ragion d'essere e sancirebbero la differenza ontologica fra esseri umani e intelligenze artificiali. Se no, beh, vita naturale e artificiale stanno sullo stesso piano. Il problema così posto, secondo Daniel Dennett ha una falla: farci assuefare all'idea quasi-impossibile che Mary sappia tutto dei colori. Cosa vuol dire "sapere tutto"? Vuol dire anche sapere quali siano tutti i qualia di chi osserva un colore? Ma tant'è: per risolvere il dilemma non vi resta che guardare il film! ;-)

Si parla di:

agamben,

Cinema,

dennett,

filosofia,

Recensioni,

scienze cognitive

Iscriviti a:

Commenti sul post (Atom)

Analisi davvero molto interessante e approfondita, complimenti!

RispondiEliminaGrazie Carolina. Vorrei trovare il tempo per commentare anche "Humans" la serie-tv anglo-americana della scorsa stagione. Mi ci vorrebbe un AI ausiliaria ;-)

Elimina